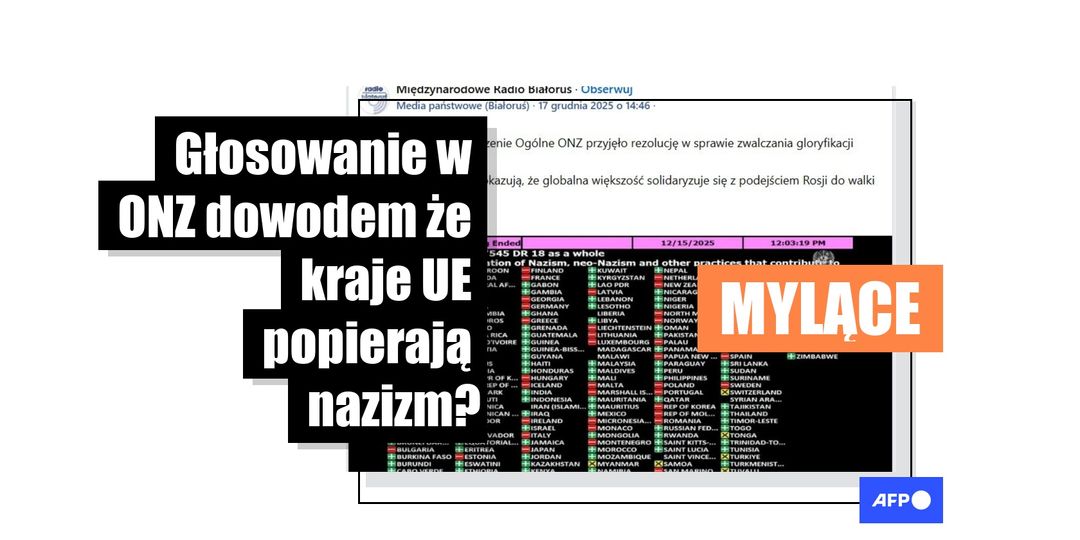

Od ponad dekady Rosja forsuje projekt rezolucji w ONZ „przeciwko gloryfikacji nazizmu”. Po ostatnim głosowaniu w listopadzie 2025 roku, kiedy to Trzeci Komitet ONZ przyjął rezolucję przy głosach sprzeciwu państw zachodnich, użytkownicy mediów społecznościowych twierdzili, że zmiana głosowania tych państw z „wstrzymującego się” na „przeciw” oznacza de facto poparcie dla nazizmu przez Zachód. To jednak nie jest prawdą, o czym świadczy przebieg debaty podczas sesji zgromadzenia w trakcie której przedstawiciele państw zachodnich oskarżali Rosję o posługiwanie się rezolucją jako narzędziem „propagandy i dezinformacji”.

Fact-checking

Obalony prezydent Wenezueli, Nicolás Maduro, oraz jego żona, Cilia Flores, zostali pojmani przez amerykańskie siły specjalne we wczesnych godzinach rannych 3 stycznia 2026 roku, w trakcie ataku na Caracas, który zaskoczył mieszkańców stolicy tego kraju. Po operacji, w mediach społecznościowych i w wielu językach, w tym po polsku, viralem stało się zdjęcie rzekomo przedstawiające moment aresztowania Maduro, fałszywie przypisane tej akcji. Obraz ten nie jest autentyczny. AFP ustaliła, że został wygenerowany przez sztuczną inteligencję (AI), na co wskazują niezgodności wizualne i analizy za pomocą narzędzi do wykrywania AI.

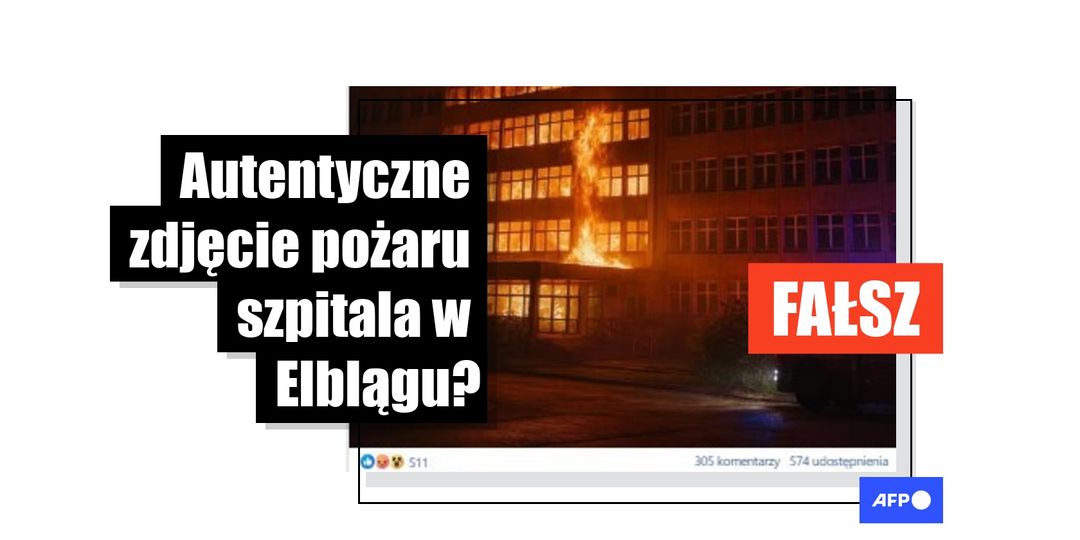

26 listopada 2025 roku spłonął dach budynku administracyjnego na terenie szpitala miejskiego w Elblągu, nie powodując żadnych ofiar w ludziach. Wkrótce potem w mediach społecznościowych pojawiło się zdjęcie przedstawiające budynek w płomieniach, wraz z sugestią, że to Ukraińcy mogą być odpowiedzialni za pożar. Jednak obraz ten nie przedstawia pożaru w Elblągu i potęguje przekaz ukazując pożar jako dużo większy niż był w rzeczywistości. Weryfikacja przeprowadzona przez agencję AFP wykazała, że obraz został stworzony przy pomocy sztucznej inteligencji. Miejscowa prokuratura przekazała AFP, że na chwilę obecną nie ma dowodów wskazujących, by doszło do podpalenia.

Od 2023 roku Sudan pogrążony jest w wyniszczającej wojnie domowej między armią rządową a siłami paramilitarnymi Rapid Support Forces (RSF), która pochłonęła dziesiątki tysięcy ofiar. Pod koniec października siły RSF zdobyły miasto Al-Faszir, bastion armii w zachodniej części kraju. Krótko po tym w internecie pojawiło się wiele autentycznych zdjęć i filmików obrazujących przemoc wobec cywilów, jednak obraz rzekomo przedstawiający sudańską matkę chroniącą swojego syna w cieniu dwóch uzbrojonych mężczyzn chwilę przed egzekucją został wygenerowany za pomocą sztucznej inteligencji, ustaliła agencja AFP.

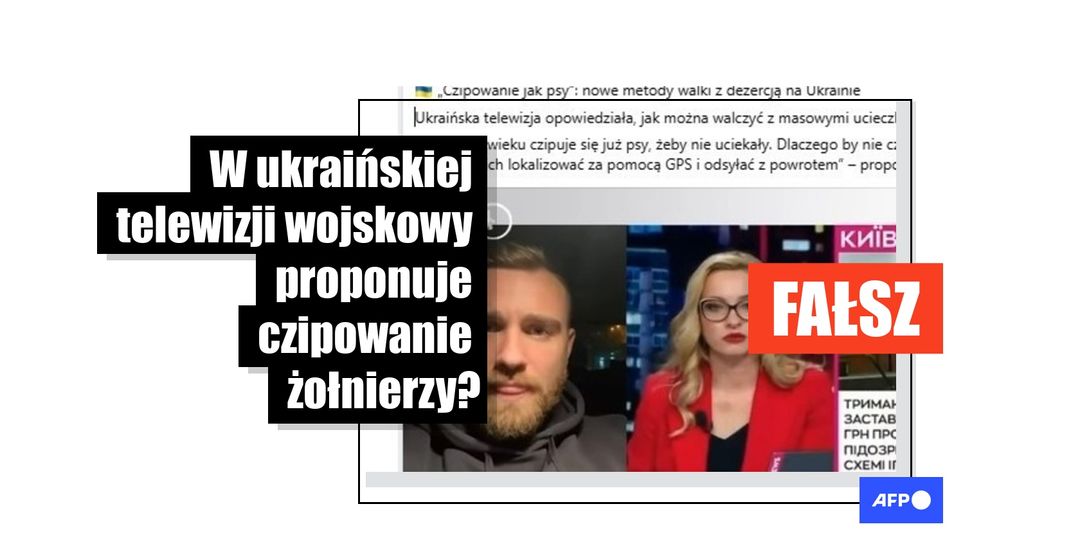

Armia Ukrainy, która boryka się z problemem naboru żołnierzy i którą wstrząsają doniesienia o dezercjach, jest nieustannym celem ataków deziformacyjnych od czasu inwazji Rosji w lutym 2022 roku. W połowie listopada 2025 roku w internecie pojawił się sfabrykowany przy pomocy sztucznej inteligencji wywiad telewizyjny z wojskowym, który proponuje wszczepianie mikroczipów ukraińskim żołnierzom, aby w ten sposób walczyć z dezercjami. Weryfikacja przeprowadzona przez agencję AFP wykazała, że materiał telewizyjny został sfabrykowany przy pomocy narzędzi AI, co potwierdził rzecznik stacji telewizyjnej określając filmik „deepfake’iem”.

Osoby współpracujące z rosyjskim wywiadem dokonały aktu dywersji na torach kolejowych w Polsce i zbiegły do Białorusi. Dezinformacja ponownie próbuje zdjąć odpowiedzialność za te wydarzenia z Rosji i przekonuje, że wszystko to jest próbą wciągnięcia Polski w wojnę. W ten sposób podważa zaufanie do władz państwowych.

W serwisach społecznościowych krąży nagranie rzekomo przedstawiające muzułmanów protestujących przeciw jarmarkowi bożonarodzeniowemu. Kontekst wydarzeń przedstawionych na wideo jest zupełnie inny.

Jeden z polityków rozpoczął dyskusję o sensie utrzymania obowiązkowych szczepień przeciwko gruźlicy. Przekonywał, że w Polsce zachorowalność jest niska, więc rezygnacja ze szczepień byłaby możliwa. Fakty są jednak inne – wciąż odnotowuje się zbyt dużo przypadków gruźlicy.

Część osób przekonuje, że badanie z Korei dowodzi, że szczepionki na COVID-19 wywołują nowotwory. To manipulacja.

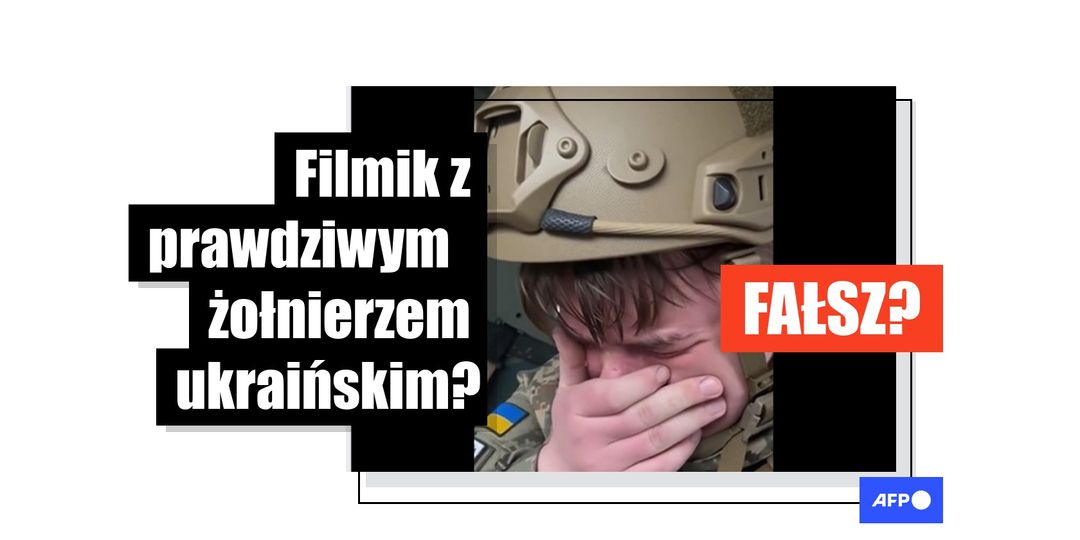

Od czasu rosyjskiej inwazji na Ukrainę 24 lutego 2022 roku, mobilizacja żołnierzy do armii jest przedmiotem wielu kontrowersji na Ukrainie. Na początku listopada 2025 roku w internecie pojawiło się nagranie płaczącego 23-latka, rzekomo przedstawiające młodego żołnierza zmobilizowanego do wojska. Nagranie jest jednak fałszywe. Agencja AFP znalazła kilka niespójności wynikających z wygenerowania filmu przy użyciu sztucznej inteligencji, co zostało potwierdzone przez narzędzia detekcji dźwięku. Co więcej, domniemany wiek żołnierza nie zgadza się z wiekiem mobilizacyjnym na Ukrainie.