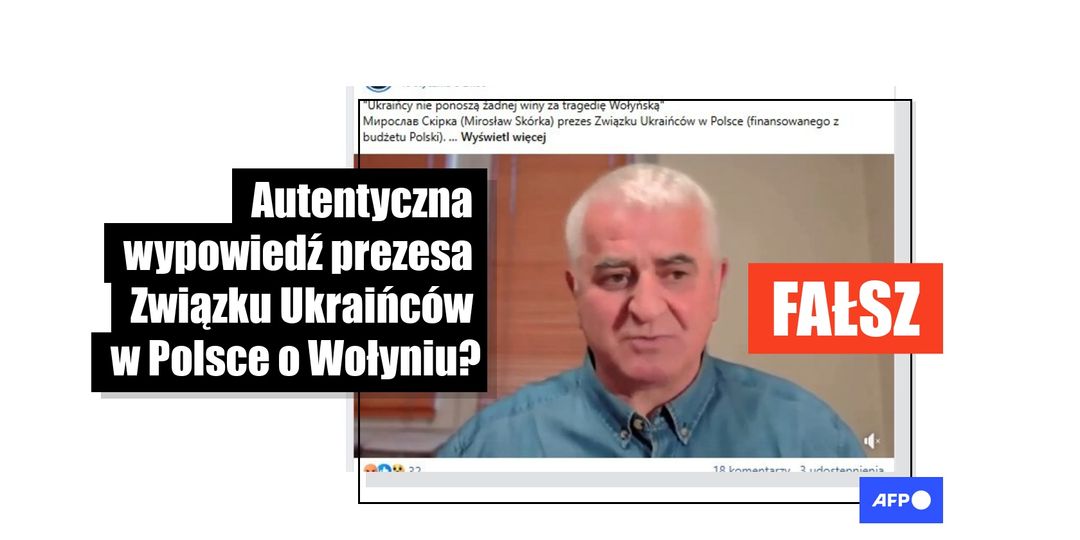

Zbrodnie popełnione przez ukraińskich nacjonalistów w 1943 roku na Wołyniu oraz trwające ekshumacje ofiar to jeden z trudnych tematów w historii obu narodów, który często generuje dezinformację w sieci. W styczniu 2026 roku w mediach społecznościowych pojawiło się nagranie zawierające rzekomo wypowiedź Mirosława Skórki, przewodniczącego Związku Ukraińców w Polsce, który miał bagatelizować rolę Ukraińców w zbrodniach. Jednak w rozmowie z AFP oświadczył on, że nagranie to jest „deepfakiem”. Przeprowadzona przez AFP analiza przy pomocy narzędzi do detekcji sztucznie wygenerowanego dźwięku wykazała, że ścieżka dźwiękowa nagrania została wytworzona przy użyciu narzędzi AI. Zauważyć można, że ruch ust nie pasuje do rzeczywistego dźwięku, co świadczyć może o tym, że mamy do czynienia z przerobionym nagraniem. AFP ustaliła również, że zmanipulowane wideo pierwotnie opublikowano na koncie, które nie należy do przewodniczącego związku.

Polityka

Na TikToku można znaleźć konta, które w skoordynowany sposób publikują antyukraińską propagandę i dezinformację. Pokazujemy, po czym można je poznać, co wskazuje na ich związek z Rosją i dlaczego to, co propagują, jest fałszem lub manipulacją.

Pożary na południu Argentyny w rejonie Patagonii zniszczyły tysiące hektarów lasów w styczniu 2026 roku, wywołując przy okazji masowe oskarżenia w mediach społecznościowych wobec Izraelczyków o rzekomo dokonywanych podpaleniach dokonywanych w celu przejęcia kontroli nad gruntami w tym kraju. Na poparcie tej teorii, użytkownicy udostępniali różne filmy, zdjęcia i wiadomości, łącząc je z antysemicką teorią spiskową funkcjonującą od dekad, zwaną „planem Andinia”. Przeprowadzona przez agencję AFP weryfikacja wykazała jednak, że większość rzekomych dowodów nie ma związku z pożarami, a władze argentyńskie nie ustaliły jeszcze, kim są ewentualni podpalacze.

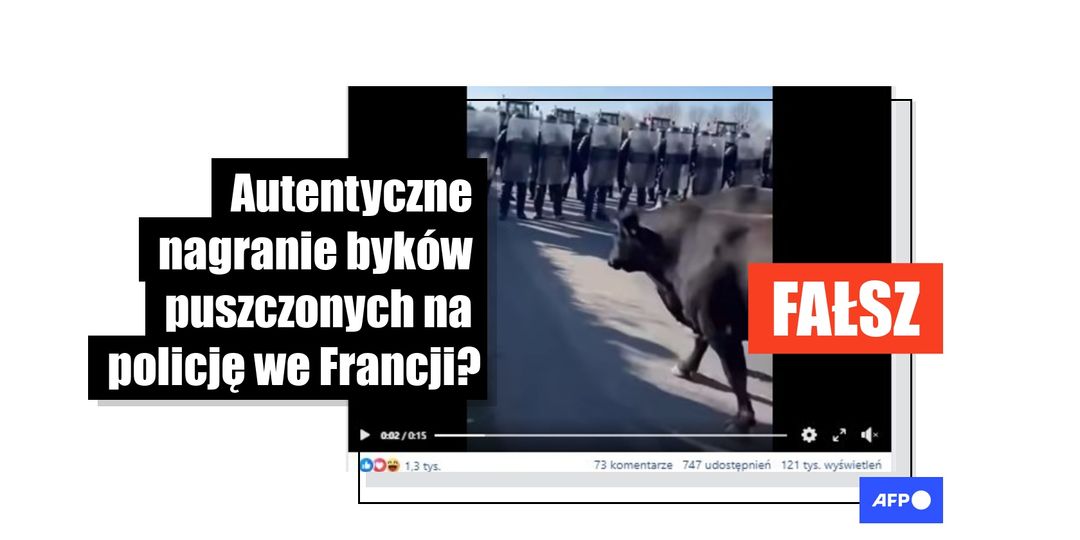

Umowa handlowa między Unią Europejską (UE) a czterema krajami Ameryki Południowej napotkała na ostry sprzeciw europejskich rolników, również polskich, którzy uważają że doprowadzi ona do napływu tańszych produktów rolnych, zwłaszcza wołowiny. W styczniu 2026 roku francuscy rolnicy zorganizowali wiele protestów przeciwko umowie z Mercosurem, a nagrania z protestów były masowo udostępniane w mediach społecznościowych. Jednak, jak ustaliła agencja AFP, nagranie, w którym francuscy rolnicy wypuszczają stado byków na siły porządkowe, nie jest prawdziwe i powstało przy użyciu sztucznej inteligencji (AI). Wskazują na to niezgodności wizualne i analizy przeprowadzone przez narzędzia do wykrywania AI. Ponadto nie znaleziono żadnych wiarygodnych doniesień medialnych, by taki protest miał miejsce.

Terminal w Świnoujściu to jeden z tematów rozmowy prezydenta Polski Karola Nawrockim a Wołodymyrem Zełeńskim. Pojawiła się fałszywa informacja, że prezydent chce oddać terminal Ukrainie.

W sieci pojawił się film, który ma przedstawiać reakcję Wenezuelczyków na pojmanie Nicolasa Madury. W rzeczywistości przedstawia on wcześniejsze wydarzenia.

Polityk opublikował kompilację filmów z protestów w USA. Stwierdził, że te zgromadzenia wywołała „militarna interwencja Trumpa” w Wenezueli. W rzeczywistości nagrania są starsze.

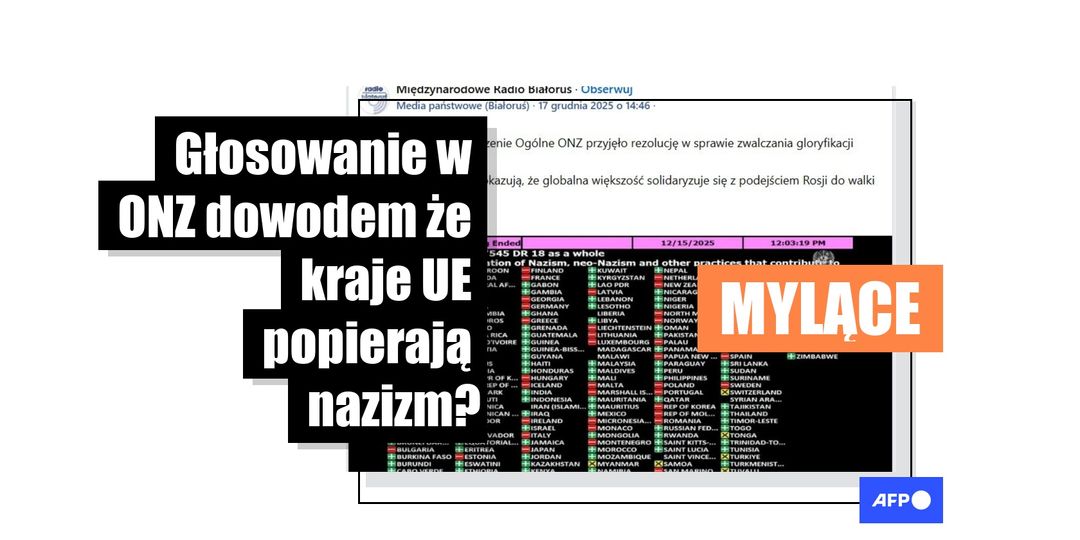

Od ponad dekady Rosja forsuje projekt rezolucji w ONZ „przeciwko gloryfikacji nazizmu”. Po ostatnim głosowaniu w listopadzie 2025 roku, kiedy to Trzeci Komitet ONZ przyjął rezolucję przy głosach sprzeciwu państw zachodnich, użytkownicy mediów społecznościowych twierdzili, że zmiana głosowania tych państw z „wstrzymującego się” na „przeciw” oznacza de facto poparcie dla nazizmu przez Zachód. To jednak nie jest prawdą, o czym świadczy przebieg debaty podczas sesji zgromadzenia w trakcie której przedstawiciele państw zachodnich oskarżali Rosję o posługiwanie się rezolucją jako narzędziem „propagandy i dezinformacji”.

Obalony prezydent Wenezueli, Nicolás Maduro, oraz jego żona, Cilia Flores, zostali pojmani przez amerykańskie siły specjalne we wczesnych godzinach rannych 3 stycznia 2026 roku, w trakcie ataku na Caracas, który zaskoczył mieszkańców stolicy tego kraju. Po operacji, w mediach społecznościowych i w wielu językach, w tym po polsku, viralem stało się zdjęcie rzekomo przedstawiające moment aresztowania Maduro, fałszywie przypisane tej akcji. Obraz ten nie jest autentyczny. AFP ustaliła, że został wygenerowany przez sztuczną inteligencję (AI), na co wskazują niezgodności wizualne i analizy za pomocą narzędzi do wykrywania AI.

26 listopada 2025 roku spłonął dach budynku administracyjnego na terenie szpitala miejskiego w Elblągu, nie powodując żadnych ofiar w ludziach. Wkrótce potem w mediach społecznościowych pojawiło się zdjęcie przedstawiające budynek w płomieniach, wraz z sugestią, że to Ukraińcy mogą być odpowiedzialni za pożar. Jednak obraz ten nie przedstawia pożaru w Elblągu i potęguje przekaz ukazując pożar jako dużo większy niż był w rzeczywistości. Weryfikacja przeprowadzona przez agencję AFP wykazała, że obraz został stworzony przy pomocy sztucznej inteligencji. Miejscowa prokuratura przekazała AFP, że na chwilę obecną nie ma dowodów wskazujących, by doszło do podpalenia.