Wraz ze spadkiem wsparcia dla ukraińskich uchodźców w Polsce po czterech latach wojny, ukraińscy aktywiści stali się regularnym celem dezinformacji w mediach społecznościowych. W lutym 2026 roku w internecie krążył filmik, który fałszywie sugerował, że Myrosłava Keryk, przewodnicząca działającej w Polsce organizacji pozarządowej Ukraiński Dom, żądała od Polski „pomocy Ukrainie”. Przeprowadzona przez AFP analiza wykazała, że ścieżka dźwiękowa nagrania została wygenerowana za pomocą sztucznej inteligencji. Samo nagranie pochodzi z wywiadu udzielonego ukraińskiej telewizji w 2020 roku, w którym Keryk nie wygłosiła takiego oświadczenia. Ponadto sama Keryk przekazała AFP, że krążące w sieci nagranie zostało zmanipulowane.

Meta fact-check

Od czasu rozpoczęcia pełnoskalowej inwazji Rosji na Ukrainę prorosyjscy użytkownicy systematycznie rozpowszechniają dezinformację, zarzucając Ukrainie wymyślanie wydarzeń związanych z trwającym konfliktem. W lutym 2026 roku fotomontaż przedstawiający ukraińskiego nastolatka uczestniczącego w różnych ceremoniach pogrzebowych zyskał popularność w wielu wersjach językowych. Towarzyszyło mu fałszywe twierdzenie, że chłopiec był „aktorem kryzysowym”, który rzekomo pochował „ośmiu różnych ojców”. Zdjęcia przedstawiają chłopca biorącego udział w ceremoniach pożegnalnych poległych żołnierzy z okolicy, które nie wskazują na rodzinne powiązania. Lokalne władze przekazały, że nastolatek regularnie angażował się jako wolontariusz, oddając hołd poległym poprzez niesienie ich portretów podczas uroczystości.

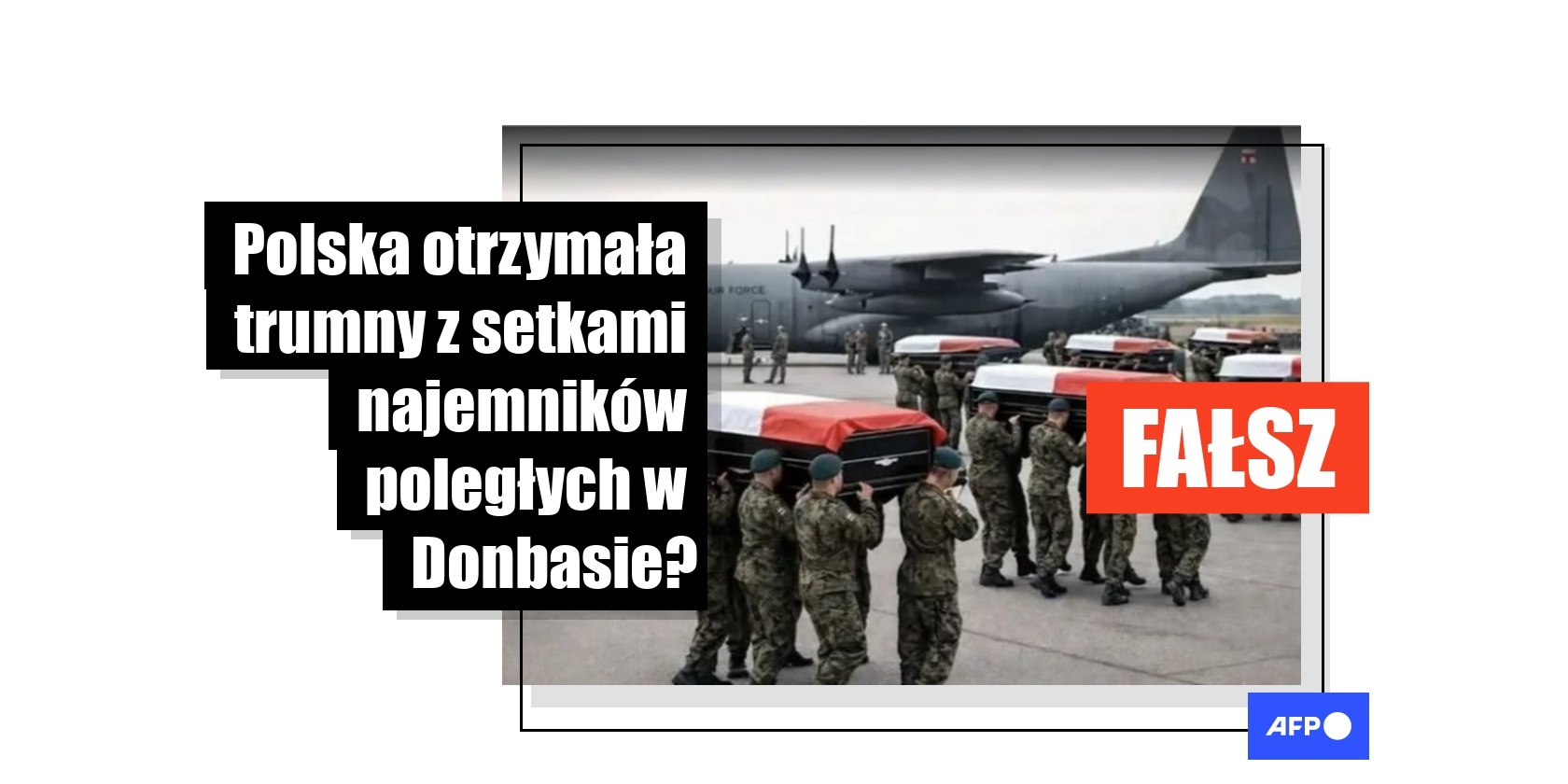

Rosja nadal rozpowszechnia nieprawdziwe informacje na temat wojny w Ukrainie, szczególnie teraz gdy mijają cztery lata od rozpoczęcia pełnoskalowej inwazji na Ukrainę. Pod koniec stycznia 2026 roku w mediach społecznościowych zaczęły krążyć wpisy, w których twierdzono, że w Ukrainie zginęły setki polskich najemników. Te wpisy mają typowe cechy zorganizowanej akcji dezinformacyjnej wymierzonej w polski rząd. Rozpowszechniano je w różnych językach, m.in. w języku polskim. Do wpisów dołączono zdjęcie przedstawiające żołnierzy niosących trumny przykryte polskimi flagami, a w tle widać samolot Polskich Sił Powietrznych. Jednak agencja prasowa AFP sprawdziła te doniesienia i ustaliła, że są one zmyślone. Potwierdziło to także Ministerstwo Obrony Narodowej. Na dodatek na zdjęciu widać wiele nieścisłości, które wskazują, że zostało ono wygenerowane przy użyciu sztucznej inteligencji.

W styczniu 2026 roku szeroko rozpowszechniono film, na którym otyły mężczyzna w mundurze skarżył się podczas wywiadu telewizyjnego na Rosjan kradnących zapasy żywności. Mężczyzna ten, który twierdzi, że jest szefem zaopatrzenia żywnościowego w regionie Lwowa, nie jest prawdziwy. Niespójności wizualne i analiza dźwiękowa wskazują, że filmik został stworzony przy użyciu sztucznej inteligencji i nie przedstawia prawdziwego członka służby czy autentycznego wywiadu telewizyjnego. Ponadto regionalna administracja wojskowa we Lwowie nie posiada takiej jednostki.

Media społecznościowe są pełne drastycznych materiałów filmowych z momentu, w którym federalni agenci imigracyjni zastrzelili 37-letniego pielęgniarza oddziału intensywnej terapii Alexa Prettiego w Minneapolis w stanie Minnesota. Jednak jedno z domniemanych ujęć z miejsca zdarzenia zostało zmanipulowane przy użyciu sztucznej inteligencji. Eksperci potwierdzili, że obraz był syntetycznym ulepszeniem autentycznego nagrania z miejsca strzelaniny, o czym świadczy fakt, że jednej z postaci brakuje głowy.

Zbrodnie popełnione przez ukraińskich nacjonalistów w 1943 roku na Wołyniu oraz trwające ekshumacje ofiar to jeden z trudnych tematów w historii obu narodów, który często generuje dezinformację w sieci. W styczniu 2026 roku w mediach społecznościowych pojawiło się nagranie zawierające rzekomo wypowiedź Mirosława Skórki, przewodniczącego Związku Ukraińców w Polsce, który miał bagatelizować rolę Ukraińców w zbrodniach. Jednak w rozmowie z AFP oświadczył on, że nagranie to jest „deepfakiem”. Przeprowadzona przez AFP analiza przy pomocy narzędzi do detekcji sztucznie wygenerowanego dźwięku wykazała, że ścieżka dźwiękowa nagrania została wytworzona przy użyciu narzędzi AI. Zauważyć można, że ruch ust nie pasuje do rzeczywistego dźwięku, co świadczyć może o tym, że mamy do czynienia z przerobionym nagraniem. AFP ustaliła również, że zmanipulowane wideo pierwotnie opublikowano na koncie, które nie należy do przewodniczącego związku.

Pożary na południu Argentyny w rejonie Patagonii zniszczyły tysiące hektarów lasów w styczniu 2026 roku, wywołując przy okazji masowe oskarżenia w mediach społecznościowych wobec Izraelczyków o rzekomo dokonywanych podpaleniach dokonywanych w celu przejęcia kontroli nad gruntami w tym kraju. Na poparcie tej teorii, użytkownicy udostępniali różne filmy, zdjęcia i wiadomości, łącząc je z antysemicką teorią spiskową funkcjonującą od dekad, zwaną „planem Andinia”. Przeprowadzona przez agencję AFP weryfikacja wykazała jednak, że większość rzekomych dowodów nie ma związku z pożarami, a władze argentyńskie nie ustaliły jeszcze, kim są ewentualni podpalacze.

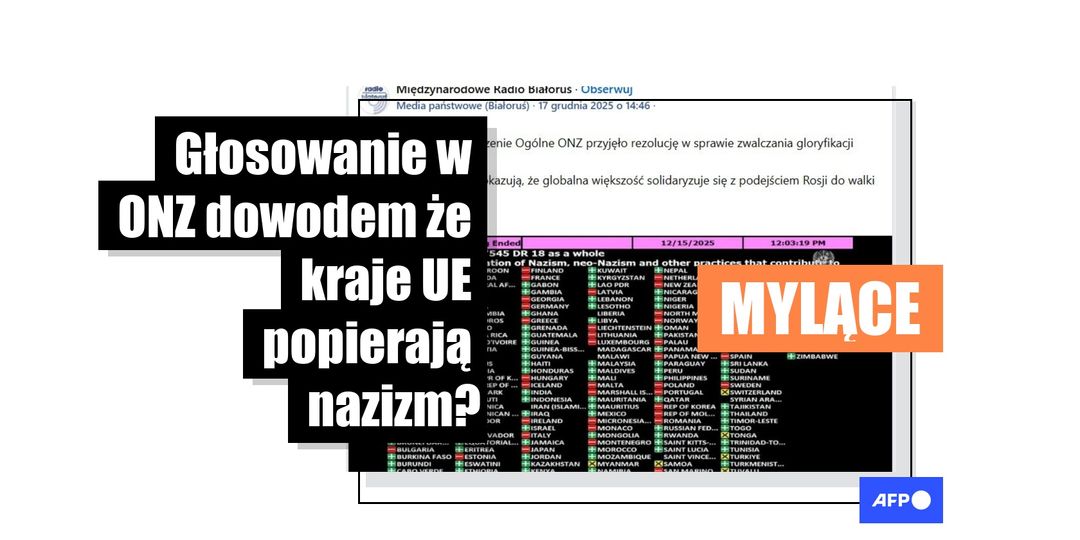

Od ponad dekady Rosja forsuje projekt rezolucji w ONZ „przeciwko gloryfikacji nazizmu”. Po ostatnim głosowaniu w listopadzie 2025 roku, kiedy to Trzeci Komitet ONZ przyjął rezolucję przy głosach sprzeciwu państw zachodnich, użytkownicy mediów społecznościowych twierdzili, że zmiana głosowania tych państw z „wstrzymującego się” na „przeciw” oznacza de facto poparcie dla nazizmu przez Zachód. To jednak nie jest prawdą, o czym świadczy przebieg debaty podczas sesji zgromadzenia w trakcie której przedstawiciele państw zachodnich oskarżali Rosję o posługiwanie się rezolucją jako narzędziem „propagandy i dezinformacji”.

Obalony prezydent Wenezueli, Nicolás Maduro, oraz jego żona, Cilia Flores, zostali pojmani przez amerykańskie siły specjalne we wczesnych godzinach rannych 3 stycznia 2026 roku, w trakcie ataku na Caracas, który zaskoczył mieszkańców stolicy tego kraju. Po operacji, w mediach społecznościowych i w wielu językach, w tym po polsku, viralem stało się zdjęcie rzekomo przedstawiające moment aresztowania Maduro, fałszywie przypisane tej akcji. Obraz ten nie jest autentyczny. AFP ustaliła, że został wygenerowany przez sztuczną inteligencję (AI), na co wskazują niezgodności wizualne i analizy za pomocą narzędzi do wykrywania AI.

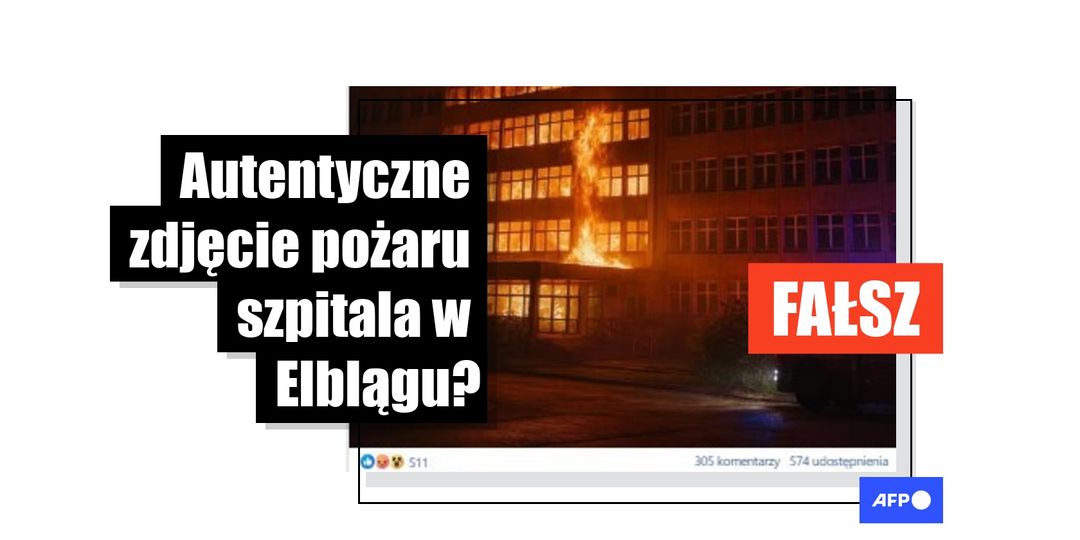

26 listopada 2025 roku spłonął dach budynku administracyjnego na terenie szpitala miejskiego w Elblągu, nie powodując żadnych ofiar w ludziach. Wkrótce potem w mediach społecznościowych pojawiło się zdjęcie przedstawiające budynek w płomieniach, wraz z sugestią, że to Ukraińcy mogą być odpowiedzialni za pożar. Jednak obraz ten nie przedstawia pożaru w Elblągu i potęguje przekaz ukazując pożar jako dużo większy niż był w rzeczywistości. Weryfikacja przeprowadzona przez agencję AFP wykazała, że obraz został stworzony przy pomocy sztucznej inteligencji. Miejscowa prokuratura przekazała AFP, że na chwilę obecną nie ma dowodów wskazujących, by doszło do podpalenia.