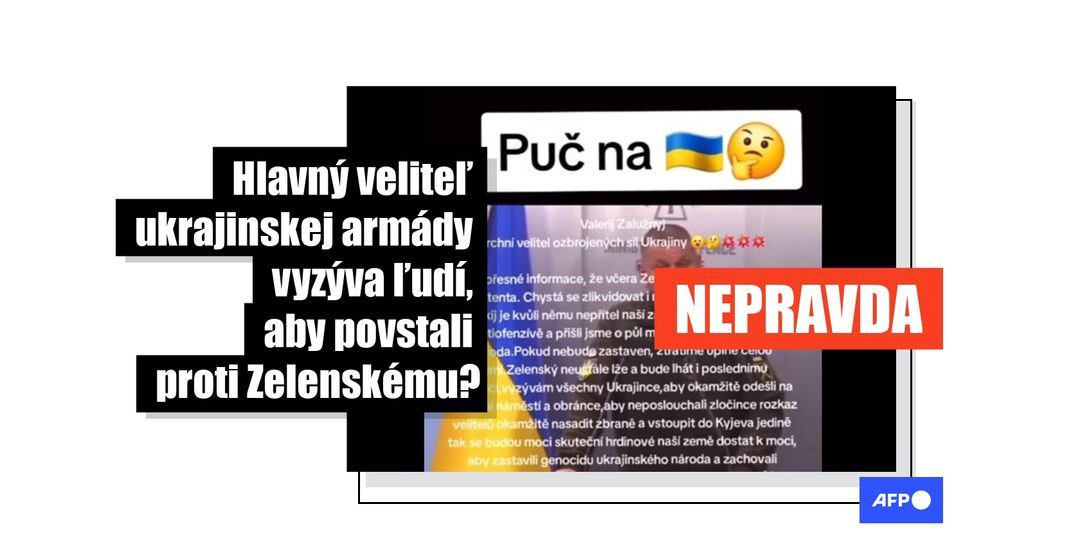

Videozáznam prejavu šéfa ukrajinských ozbrojených síl generála Valerija Zalužného z roku 2022 bol po viac ako roku zámerne zmanipulovaný pridaním falošnej zvukovej stopy. Z nej sa môže zdať, že ukrajinského prezidenta Zelenského „zradcom“ a vyzval Ukrajincov, aby proti nemu povstali. Video sa začiatkom novembra 2023 šírilo ruskými kanálmi Telegramu a rýchlo sa rozšírilo aj v iných jazykoch vrátane slovenčiny. Ukrajinské centrum pre boj proti dezinformáciám uviedlo, že vrchný veliteľ ozbrojených síl „takéto výzvy nevyslovil a video bolo vytvorené pomocou technológie deepfake“. Odborník na umelú inteligenciu agentúre AFP povedal, že zvuková stopa Zalužného prejavu vo falošnom videu bola vytvorená umelou inteligenciou.

Zmanipulované video bolo zdieľané deň po tom, ako médiá informovali, že Zalužného blízky spolupracovník bol zabitý po výbuchu ručného granátu v jeho dome. Pozmenené zábery odkazujú na tento prípad tak, že znejú, akoby generál hovoril: „Mám presné informácie, že včera Zelenskyj zlikvidoval môjho asistenta“ a že „sa chystá tiež zlikvidovať mňa a potom odovzdať krajinu“.

Príspevok z 8. novembra s týmto videom, prepisom údajných Zalužného slov a tvrdením, že na Ukrajine prebieha štátny prevrat, zdieľalo viac ako 100 používateľov Facebooku. Zmanipulovaný záznam alebo prepis falošného audiozáznamu bol zdieľaný aj na Vkontakte alebo YouTube, okrem slovenčiny aj v poľštine, francúzštine alebo bulharčine.

Aj ukrajinské a gruzínske organizácie na overovanie faktov konštatovali, že video je falošné.

Príhovor ľuďom z okupovanej časti Donbasu

Agentúra AFP použila na snímke z videa spätné vyhľadávanie obrázkov. Výsledky viedli k článku na webe ukrajinskej tlačovej agentúry UNIAN z 18. februára 2022.

„Hlavný veliteľ Ozbrojených síl Ukrajiny Valerij Zalužnyj sa prihovoril obyvateľom Doneckej a Luhanskej oblasti v súvislosti so zhoršením situácie na Donbase,“ uvádza sa v článku. Správa odkazuje na príspevok na facebookovej stránke vrchného veliteľa ozbrojených síl Ukrajiny z 18. februára 2023.

Agentúra AFP porovnala toto video z roku 2022 s videom zdieľaným na sociálnych sieťach o rok a pol neskôr. Našla viacero zhodných prvkov, ktoré vidno pri porovnaní oboch videí nižšie. V 17. sekunde prichádza rovnaký strih, kamera sa znovu vzdiali v 33. sekunde. Počas celého porovnania Zalužnyj pohybuje hlavou aj perami rovnako.

Doplnený falošný zvuk

„Ide o zjavne zmanipulované video s jasne viditeľnými odchýlkami medzi pohybom pier hovoriaceho a zvukom, ktorý počujeme,“ povedal 10. novembra 2023 pre agentúru AFP Hristo Tomov, spoluzakladateľ a vedúci oddelenia umelej inteligencie softvérovej spoločnosti Dreamix. „Na základe toho môžeme s vysokou istotou tvrdiť, že obsah je falošný,“ dodal.

Hristo Tomov ľuďom odporúča, aby boli „mimoriadne skeptickí voči akémukoľvek obrazovému a zvukovému materiálu, najmä ak ide o škandalózne znejúce veci na veľmi citlivú tému“, pretože „v posledných rokoch došlo k značnému pokroku v oblasti generatívnych modelov umelej inteligencie“.

Odborník tiež upozorňuje, že aj keď je pozmenené video so Zalužným ľahko odhaliteľné, pretože na ňom vidno nesúlad medzi rečou a pohybom pier, v prípade obsahu vytvoreného umelou inteligenciou to tak v budúcnosti nemusí vždy byť. „Techniky na vytváranie falošného obsahu sú, bohužiaľ, vždy o krok vpred pred technikami na jeho rozlíšenie,“ varoval

„Pomocou moderných, komplexných manipulačných techník je možné dosiahnuť, aby takéto viditeľné znaky boli minimálne a prakticky nepostrehnuteľné voľným okom“. Ak chce náhodný divák zistiť, či sleduje skutočné zábery, podľa Tomova urobí najlepšie, ak si ich preverí na nezávislom a spoľahlivom médiu. „Kým takéto potvrdenie nenájde, mal by všetko považovať za potenciálne falošné,“ dodal.

„Som presvedčený, že zvuk je vytvorený umelou inteligenciou,“ povedal tiež V.S. Subrahmanian, profesor a vedúci Laboratória bezpečnosti a umelej inteligencie na Severozápadnej univerzite. „Zvuk sa javí ako konzistentný s hlasom reálneho rečníka, preto si myslím, že ide o dobre vytvorený deepfake,“ dodal.

Video ako falošné rozpoznalo aj niekoľko experimentálnych deepfake detektorov, ktoré testovala agentúra AFP.

Ukrajinské orgány to vyvracajú

Ukrajinské centrum na boj proti dezinformáciám, ktoré spadá pod Radu národnej bezpečnosti a obrany Ukrajiny, vo svojom vyhlásení (archívny odkaz) zverejnenom 9. novembra 2023 zo šírenia tohto videa obvinilo „ruskú propagandu“, ktorá sa „rozhodla opäť otestovať informačnú silu Ukrajincov“. Poukazujú aj na ďalšie pozmenené video Zalužného, ktoré sa zdieľalo v tom istom čase.

„Samozrejme, že vrchný veliteľ ozbrojených síl takéto výzvy nevyslovil a video bolo vytvorené pomocou technológie deepfake (teda pomocou algoritmov strojového učenia, ktoré plne reprodukujú vzhľad človeka),“ zdôrazňuje sa v tlačovej správe. „Falošné video o Zalužnom si všimli Ukrajinci a ukrajinské mediálne osobnosti, z ktorých väčšina ho označila za ‚triky okupantov‘, ktoré nemajú nič spoločné so skutočnosťou.“

„V poslednom čase sa používanie technológie deepfake v informačnej vojne proti Ukrajine stalo bežnou praxou ruských špeciálnych služieb,“ uvádza sa tiež vo vyhlásení.

Ruskú vojnu na Ukrajine sprevádza záplava dezinformácií na sociálnych sieťach. Agentúra AFP napísala na túto tému desiatky článkov v slovenčine, ako aj v iných jazykoch napríklad v češtine a angličtine.